Voor deep learning begon computer vision met een bescheidener doel: patronen spotten in ruwe pixels. Net zoals NLP ooit vertrouwde op bag-of-words (woorden tellen zonder context), steunden vroege visiesystemen op basis-featuredetectie—randen, hoeken en texturen—die gecombineerd konden worden tot ruwe visuele beschrijvingen.

De Eerste Stap: Randen

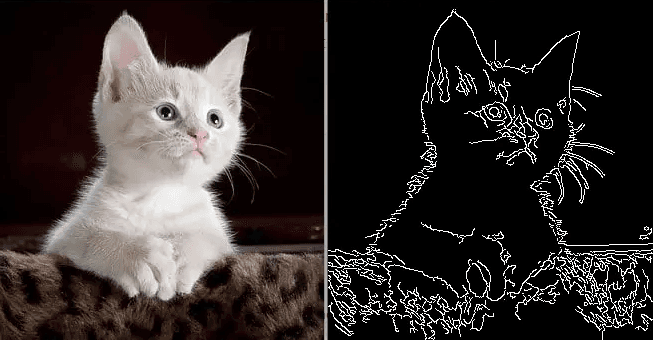

Randen markeren de grenzen waar pixelwaarden scherp veranderen—zoals de contour van de oren van een kat tegen een bank. Het detecteren van randen was een van de eerste doorbraken in computer vision omdat het de chaos van miljoenen pixels reduceerde tot iets gestructureerds.

🏞️ Randdetectie Voorbeeld Een randdetector past een filter toe dat plotselinge sprongen in helderheid benadrukt. Horizontale filters halen snorharen eruit, verticale filters markeren strepen, diagonale filters volgen de contouren van oren.

Algoritmes zoals de Canny edge detector werden klassiekers in de jaren ’80, in staat verrassend scherpe contouren van objecten te produceren. Zelfs vandaag worden Canny-randen nog steeds gebruikt als snelle voorbewerking of visualisatietools—bewijs dat sommige van deze vroege ideeën relevant zijn gebleven.

Hoeken, Texturen En Simpele Features

Randen alleen zijn niet genoeg—je moet ook weten waar ze samenkomen of zich herhalen.

- Hoeken: waar twee randen elkaar kruisen, en zo belangrijke herkenningspunten markeren zoals de hoek van een oog of de rand van een gebouw.

- Texturen: herhalende patronen zoals vacht, bakstenen muren of gras.

- Gradiënten: vloeiende veranderingen in helderheid of kleur, die wijzen op schaduwen en diepte.

Een foto van een kat, teruggebracht tot deze features, kan gelezen worden als: korte dunne lijnen (snorharen), wazige texturen (vacht), twee cirkelvormige vlekken (ogen).

Het is geen herkenning, maar wel een gecomprimeerde beschrijving van wat er in de scène zit.

De Analogie Met NLP

Deze fase van computer vision lijkt sterk op bag-of-words in NLP:

- Bag-of-words: telt woordvoorkomens maar negeert grammatica.

- Vroege visie: detecteert randen/texturen maar negeert globale vorm.

Beide benaderingen vangen alleen lokale signalen. Net zoals bag-of-words niet kan bepalen of “niet slecht” positief is, kan een randmap geen tijger onderscheiden van een gestreepte sofa.

Bouwstenen, Geen Begrip

Deze detectoren leverden bouwstenen voor meer geavanceerde algoritmes:

- Met randen kon je vormen omlijnen.

- Met hoeken kon je sleutelpunten matchen tussen afbeeldingen (handig voor panorama’s samenvoegen).

- Met texturen kon je materialen karakteriseren zoals hout, stof of steen.

Maar de systemen waren kwetsbaar. Verander de hoek, belichting of achtergrond, en herkenning mislukte vaak. Een kat was niet “snorharen + vacht + oren”—het was slechts een losse verzameling patronen.

🦓 Zebra Voorbeeld: Laat een eenvoudige randdetector een zebra zien achter hoog gras. De detector registreert vrolijk “veel strepen”—maar kan niet onderscheiden of ze bij een zebra, het gras of zelfs een hek horen. Mensen lossen dit moeiteloos op, maar vroege systemen konden dat niet.

Het Overgangspunt

Patronen herkennen was een noodzakelijke basis. Het bewees dat pixels konden worden omgezet in bruikbare signalen en dat lokale structuur ertoe deed. Maar net als bag-of-words liep het tegen een plafond aan: te kwetsbaar, te oppervlakkig, te handgemaakt.

De volgende sprong—automatisch features leren—zou alles veranderen. In plaats van randdetectors handmatig te schrijven, begonnen netwerken features zelf te leren, ze te stapelen tot diepere, meer abstracte hiërarchieën. Deze verschuiving weerspiegelt hoe NLP evolueerde van woordtellingen naar embeddings en neurale modellen.

Belangrijkste Inzichten

Vroege computer vision draaide om het handmatig detecteren van simpele patronen—randen, hoeken, texturen—die ruwe pixels omzetten in signalen. Deze features werkten als de “woorden” van visuele data, maar ze misten de kracht om volledige objecten of betekenis vast te leggen. Ze effenden het pad voor CNN’s, die deze patronen automatisch konden leren en combineren tot hogere concepten. Patronen herkennen is de brug tussen ruwe pixels en modern deep learning in visie.