Wanneer je naar een foto van een kat kijkt, merk je niet bewust de duizenden details op—vachttextuur, belichting, achtergrond—maar je hersenen zetten ze onmiddellijk samen. Computers hebben dat voordeel niet. Voor hen is hetzelfde beeld niets meer dan een enorme spreadsheet van getallen: miljoenen kleine gekleurde puntjes die pixels worden genoemd.

In deze representatie zijn er geen "katten" of "snorharen"—alleen patronen van helderheid en kleur. Computer vision is het vakgebied dat dit probleem aanpakt: hoe ruwe pixels om te zetten in begrip. Het is de brug tussen getallen en visuele concepten, van het detecteren van tumoren in scans tot het aandrijven van zelfrijdende auto’s.

Wat Computers Eigenlijk "Zien"

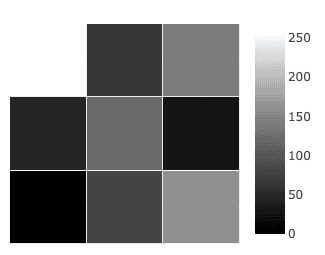

Digitale afbeeldingen zijn niets magisch—het zijn gewoon matrices van getallen. We hebben dit al behandeld in Hoofdstuk 2, maar laten we het idee kort opfrissen:

- Een grijswaardenfoto is een raster waarin elke cel de helderheid opslaat: 0 voor zwart, 255 voor wit, en waarden daartussen voor grijstinten.

- Een kleurenfoto stapelt drie matrices—rood, groen en blauw (RGB). Elke pixel is een drietal zoals voor paars.

Samen vormen alle pixels een afbeelding:

Een smartphonefoto kan 12 miljoen pixels hebben, elk met drie waarden. Dat zijn 36 miljoen getallen voor één enkele foto. Op de een of andere manier moeten computers in deze zee van getallen patronen vinden die overeenkomen met “kat”, “auto” of “verkeerslicht”.

Waarom Visie Moeilijk Is

Getallen omzetten in objecten is veel uitdagender dan het klinkt. Een enkel object—bijvoorbeeld een kat—kan op eindeloos veel manieren verschijnen:

- Variatie: Verschillende belichting, hoeken en afstanden veranderen pixelwaarden volledig.

- Occlusie: Objecten zijn vaak gedeeltelijk verborgen, zoals een kat die achter een bank gluurt.

- Context: Hetzelfde patroon kan verschillende dingen betekenen—een gestreept vlak kan een tijger, een basketbal of een waarschuwingsbord zijn.

- Schaal: Een object kan het hele beeld vullen of slechts een klein stipje zijn.

Mensen gaan hier moeiteloos mee om omdat onze hersenen bedraad zijn voor invariantie. Voor machines worden dit kernuitdagingen:

- Een kat die zijwaarts gedraaid is, blijft een kat.

- Een kat in de hoek moet hetzelfde worden herkend als een kat in het midden.

- Een kat in daglicht en in schaduw blijft hetzelfde object.

Computer vision-modellen moeten deze invarianties leren om in de echte wereld te functioneren.

Van Ruwe Pixels Naar Features

Vroege visiesystemen probeerden met handgemaakte regels te werken, zoals: “zoek naar twee driehoeken boven twee cirkels om een kattengezicht te vinden.” Dit stortte al snel in—te veel variatie, te veel uitzonderingen.

De doorbraak was om systemen features automatisch te laten leren via machine learning, opgebouwd in lagen:

- Laag-niveau: randen, hoeken, texturen, eenvoudige gradiënten.

- Midden-niveau: krommen, objectdelen (ogen, wielen, bladeren).

- Hoog-niveau: volledige objecten (katten, auto’s, bomen).

📸 Canny Edge Voorbeeld: Een vroeg voorbeeld is de Canny Edge Detector, die randen identificeert door pixelintensiteiten te analyseren en afgeleiden te gebruiken om plotselinge veranderingen in waarde te detecteren (net zoals afgeleiden verandering meten):

Dit gelaagde leren weerspiegelt hoe onze visuele cortex werkt—eerst randen detecteren, dan vormen, en vervolgens volledige scènes.

Voorbewerking Van De Afbeelding

Voordat features kunnen worden geleerd, worden afbeeldingen meestal gestandaardiseerd.

- Normalisatie: Pixelwaarden worden geschaald (bijv. 0–1) om training stabiel te maken.

- Resizing: Verschillende foto’s worden herschaald (bijv. ) zodat het netwerk consistente input heeft.

- Data augmentatie: Trainingsbeelden worden lichtjes geroteerd, gespiegeld, verhelderd of vervaagd—het model leert zo dat deze variaties de identiteit niet veranderen.

- Kleurruimten: Soms worden afbeeldingen omgezet van RGB naar HSV, waarbij helderheid wordt gescheiden van kleur, wat helpt bij veranderingen in belichting.

Deze stappen maken visiemodellen robuuster en leren ze dat een iets helderder of gespiegeld beeld van een kat nog steeds een kat is.

Verbanden Met Eerdere Concepten

Computer vision lijkt misschien nieuw, maar het bouwt direct voort op wat je al hebt gezien:

- Matrices & lineaire algebra: afbeeldingen zijn rasters van getallen, en filters zijn gewoon matrixoperaties.

- Patroonherkenning: we zoeken naar patronen in pixels, niet in woorden.

- Feature learning: net zoals embeddings semantische gelijkenis vastlegden in NLP, leggen geleerde visuele features gelijkenis in uiterlijk vast.

Kortom, dezelfde wiskunde ligt ten grondslag aan zowel visie als taal—alleen de data verschillen.

Toepassingen In De Praktijk

Computer vision heeft talloze industrieën getransformeerd door geautomatiseerde analyse van visuele informatie mogelijk te maken op een schaal die voor mensen onmogelijk is.

🩻 Medische Beeldvorming: AI-systemen scannen röntgenfoto’s of MRI’s en markeren verdachte gebieden, zoals kleine breuken of vroege tumoren, en fungeren als een extra paar ogen voor artsen.

🚗 Zelfrijdende Auto’s: Camera’s voeren beelden in vision-modellen die verkeersborden, wegmarkeringen, voetgangers en andere voertuigen detecteren, zodat de auto zijn omgeving in real time kan “zien”.

🏭 Kwaliteitscontrole In De Productie: Hogesnelheidscamera’s op productielijnen controleren producten op gebreken die kleiner zijn dan het menselijk oog kan waarnemen, waardoor precisie op schaal wordt gegarandeerd.

🕵️ Beveiliging En Toezicht: Visiesystemen analyseren videobeelden om ongebruikelijke activiteiten te detecteren, gezichten te herkennen of menigtes in drukke gebieden te schatten.

Deze toepassingen illustreren hoe computer vision de menselijke waarneming uitbreidt en nieuwe mogelijkheden ontsluit in wetenschap, industrie en het dagelijks leven.

De Beperkingen En Uitdagingen

Ondanks vooruitgang is computer vision niet onfeilbaar. Er zijn nog steeds talloze problemen op te lossen:

- Kleine pixelveranderingen (onmerkbaar voor mensen) kunnen systemen misleiden—een stopbord verandert in een “voorrang verlenen”-bord.

- Modellen falen vaak buiten hun trainingsdomein (bijv. getraind op stockfoto’s, maar getest op wazige CCTV-beelden).

- Ze herkennen patronen maar “begrijpen” ze niet—een kat is een object, geen levend wezen dat zorg nodig heeft.

- Bias sluipt erin als trainingsdata bepaalde mensen of contexten ondervertegenwoordigen.

- Real-time visie (zoals in zelfrijdende auto’s) vereist enorme rekenkracht.

Deze benadrukken de kloof tussen herkenning (patronen spotten) en begrip (betekenis vatten).

Vooruitblik

De grens van vision AI verschuift van “wat staat er op de foto?” naar “wat betekent het?”

- Modellen beschrijven nu afbeeldingen in woorden of beantwoorden er vragen over.

- Visie wordt gecombineerd met taal in multimodale modellen die zowel tekst als beelden begrijpen.

- Dezelfde principes worden omgekeerd: in plaats van objecten te herkennen, genereren modellen nu nieuwe beelden uit tekstprompts.

Dit opent de deur naar AI die niet alleen ziet, maar ook creëert—een onderwerp waar we in het volgende hoofdstuk dieper op ingaan.

Belangrijkste Inzichten

Computer vision begint met simpele getallen—pixelrasters—maar bouwt op via geleerde features om objecten en scènes te herkennen. De uitdagingen van variatie, occlusie en schaal maken visie moeilijk, maar technieken zoals voorbewerking, feature learning en omgaan met invariantie maken het mogelijk.

Vandaag de dag drijft computer vision toepassingen aan van de gezondheidszorg tot zelfrijdende auto’s, terwijl het ook te maken heeft met uitdagingen rond robuustheid, bias en echt begrip. De volgende sprong is multimodale AI, waarbij machines zowel zien als creëren, en ons dichter bij menselijke waarneming brengen.