Taal is sterk contextueel. Het woord "bank" betekent iets anders in “I went to the bank” dan in “I sat by the river bank”. Het woord "lead" verandert van uitspraak tussen “lead the team” en “lead pipes”. Zelfs eenvoudige voornaamwoorden als "it" of "they" zijn volledig afhankelijk van eerdere context om betekenisvol te zijn.

Om taal goed te verwerken, moet AI verder gaan dan individuele woorden en rekening houden met de omringende tekst, het bredere gesprek en zelfs achtergrondkennis. Dit vermogen om context te volgen is een van de grootste redenen waarom moderne taalmodellen veel capabeler zijn dan eerdere systemen—en waarom attention-mechanismen zo’n doorbraak waren in natural language processing.

Waarom Context Alles Verandert

Context kan betekenis volledig hervormen.

- “The man saw the dog with the telescope” kan betekenen dat ofwel de man ofwel de hond de telescoop had.

- “Time flies like an arrow” kan poëtisch zijn—of absurde instructies aan insecten.

Mensen lossen deze dubbelzinnigheden moeiteloos op, maar vroege AI-systemen die woorden geïsoleerd behandelden, faalden vaak op grappige manieren. Soorten context die betekenis vormgeven:

- Lokale context: nabijgelegen woorden die grammatica en directe betekenis sturen.

- Documentcontext: het algemene onderwerp of thema van een tekst.

- Gesprekscontext: bijhouden waar voornaamwoorden naar verwijzen.

- Wereldcontext: achtergrondkennis, cultuur en gedeelde aannames.

Door context op meerdere niveaus te integreren, gaan moderne AI-systemen verder dan geïsoleerde woorden en vatten ze de rijkere, genuanceerde betekenissen die mensen van nature begrijpen.

De Uitdaging van Woordvolgorde

Context is niet de enige belangrijke eigenschap van taal. Taal is ook sequentieel: “Dog bites man” is niet hetzelfde als “Man bites dog”.

Vroege “bag-of-words”-modellen negeerden woordvolgorde volledig en behandelden beide zinnen als hetzelfde. Dit vereenvoudigde de verwerking, maar wiste cruciale betekenis uit. Neurale modellen moesten leren dat volgorde informatie draagt over grammatica, tijd en causaliteit.

- Grammatica en syntaxis: “The quick brown fox” is logisch, terwijl “quick the brown fox” de Engelse woordvolgorde schendt.

- Tijd- en causale aanwijzingen: “I woke up and had breakfast” impliceert een volgorde; omkeren doet dat niet.

- Compositionele betekenis: “Green house” (een groen geverfd huis) verschilt van “greenhouse” (een kas voor planten).

Het herkennen en modelleren van woordvolgorde stelt neurale netwerken in staat de structuur en logica van taal te vatten, en ruwe reeksen om te zetten in betekenisvolle communicatie.

Contextvensters: Hoeveel Geschiedenis Ertoe Doet

Taal ontvouwt zich in de tijd, en AI-modellen gebruiken contextvensters om te bepalen hoeveel eerdere tekst ze meenemen.

- Vaste vensters: Vroege modellen keken 50–200 woorden terug—beter dan n-grams, maar nog steeds beperkt.

- Schuivende vensters: Naarmate tekst groeit, beweegt het venster mee, waarbij oude woorden worden weggelaten en nieuwe worden toegevoegd.

- Moderne uitbreidingen: Tegenwoordig kunnen modellen duizenden—of zelfs 100.000+ woorden aan, waardoor samenhang over essays, verhalen of lange gesprekken behouden blijft.

Toch kan het model “vergeten” als belangrijke details buiten het venster vallen, wat tot inconsistenties leidt. Tegenwoordig hebben modellen duizenden tokens in hun contextvenster.

De Attention-Revolutie

De echte sprong kwam met attention-mechanismen. Je herinnert je misschien uit Hoofdstuk 4 dat attention een model in staat stelt verschillende woorden in de input te wegen in plaats van ze allemaal gelijk te behandelen.

Dit blijkt precies te zijn wat nodig is voor het omgaan met context: in plaats van eerdere woorden samen te persen tot één vaste samenvatting, kan het model dynamisch focussen op de meest relevante stukjes informatie bij het voorspellen van het volgende woord.

- In “The cat that was sleeping in the sun finally…” zou het model het sterkst moeten letten op "cat" en "sleeping", niet op vulwoorden als "the" of "in".

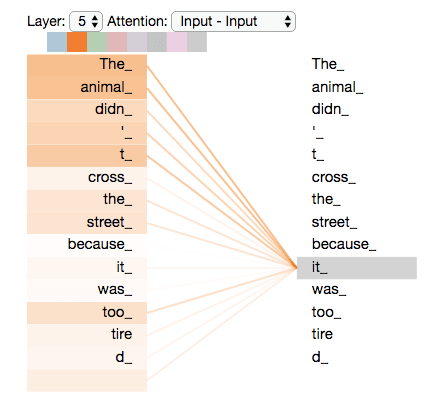

- In “The animal didn’t cross the street because it was too tired” stelt attention het model in staat "it" te koppelen aan "animal" in plaats van per vergissing aan "street".

Deze dynamische weging maakt voorspellingen nauwkeuriger, vooral bij het oplossen van ambiguïteit of langafstand verwijzingen. In tegenstelling tot methoden met vaste vensters markeert attention de woorden die het meest relevant zijn voor de huidige beslissing.

Het werkt ook op meerdere schalen: sommige heads focussen op nabije grammatica, terwijl andere verre frasen verbinden, zodat het model zowel lokale structuur als langetermijnafhankelijkheden kan vastleggen.

Door deze technieken te combineren, transformeert attention de omgang met context van een bot geheugenbereik naar een gerichte spotlight, waardoor moderne modellen zinnen veel genuanceerder kunnen interpreteren dan eerdere methoden.

Multi-Head Attention: Parallelle Contexten

Moderne modellen gaan verder met multi-head attention. Elke “head” focust parallel op een andere relatie:

- Syntactisch: onderwerpen met werkwoorden, bijvoeglijke naamwoorden met zelfstandige naamwoorden.

- Semantisch: verwante concepten.

- Coreferentie: voornaamwoorden naar de juiste zelfstandige naamwoorden.

- Langeafstandsverbindingen: samenhang over alinea’s.

- Positie: effecten van woordvolgorde.

In “The red car that I bought yesterday is parked outside” kan één head bijhouden dat "car" het onderwerp is, een andere dat "red" het beschrijft, en weer een andere dat "yesterday" de tijd aangeeft. Samen leveren deze perspectieven een rijke, gelaagde interpretatie.

Dit vermogen om meerdere soorten context tegelijk te verwerken is waarom Transformer-gebaseerde modellen zo dominant zijn geworden.

Context Over Verschillende Schalen

Context gaat niet alleen over directe buren—het werkt op vele niveaus:

- Woordniveau: “The quick brown” suggereert dat er een zelfstandig naamwoord komt.

- Zinsniveau: “The dog chased the cat” vertelt wie wat deed.

- Discoursniveau: Latere verwijzingen zoals “he”, “the commander in chief” of “the administration” verwijzen allemaal terug naar "the president".

- Documentniveau: “Cells” betekent iets anders in de biologie dan in gevangenissen.

- Gespreksniveau: In dialoog hangt betekenis af van gedeelde kennis, doelen en beurtwisseling.

Moderne modellen proberen al deze schalen tegelijk te jongleren.

De Grenzen van Contextbegrip

Zelfs geavanceerde modellen hebben nog uitdagingen:

- Lengtebeperkingen: Contextvensters zijn groot maar niet oneindig; oudere details kunnen verloren gaan.

- Impliciete kennis: Idiomen zoals “raining cats and dogs” of culturele verwijzingen zetten modellen vaak op het verkeerde been.

- Dynamische herinterpretatie: Mensen herinterpreteren eerdere tekst gemakkelijk wanneer nieuwe aanwijzingen verschijnen; AI heeft moeite om zijn begrip bij te werken.

- Voorbij tekst: Echte menselijke communicatie gebruikt toon, gebaren en omgeving—aanwijzingen die tekst-only modellen missen.

Deze hiaten tonen aan waarom AI-contextverwerking krachtig is maar nog niet gelijkstaat aan menselijk begrip.

Context in Moderne Taalmodellen

Moderne systemen pakken context op verschillende manieren aan:

- Contextuele woordrepresentaties: In tegenstelling tot statische embeddings veranderen woorden nu van representatie op basis van context ("bank" in financiën ≠ "bank" bij een rivier).

- Contextbewuste generatie: Outputs hangen niet alleen af van de directe input, maar ook van het bredere gesprek.

- In-context learning: Modellen kunnen zich ter plekke aanpassen door voorbeelden binnen een gesprek te gebruiken om nieuwe regels of definities toe te passen.

- Emergent redeneren: Door context zorgvuldig te volgen, kunnen modellen meerstapsproblemen oplossen en logische consistentie behouden.

Deze mogelijkheden verklaren waarom taalmodellen veel intelligenter aanvoelen dan oudere systemen die op woordtellingen of eenvoudige n-grams waren gebaseerd.

Belangrijkste Inzichten

Context is wat reeksen woorden omzet in echte betekenis. De ontwikkeling van attention en grotere contextvensters stelde AI-systemen in staat om syntaxis, semantiek en discours te vatten op manieren die eerdere modellen nooit konden.

Moderne modellen kunnen meerdere lagen van context tegelijkertijd volgen, waardoor ze effectieve gesprekspartners en probleemoplossers zijn. Maar ze worstelen nog steeds met zeer lange gesprekken, culturele achtergrondkennis en echt dynamische interpretatie—gebieden waarin menselijk begrip nog steeds de overhand heeft.