In de kern van elk taal-AI-systeem—of het nu de autocomplete op je telefoon is of ChatGPT—ligt een eenvoudig idee: voorspel het volgende woord. Deze taak, language modeling, stelt machines in staat om niet alleen tekst te verwerken maar ook te genereren—verhalen te schrijven, vragen te beantwoorden of gesprekken te voeren.

Als een AI betrouwbaar het volgende woord in een zin kan raden, moet het iets hebben geleerd over grammatica, vocabulaire, context en zelfs kennis van de echte wereld. Wat begon als eenvoudig patroonmatchen is uitgegroeid tot de basis van de meest geavanceerde AI-systemen van vandaag.

Voorspellen Wat Hierna Komt

Language modeling draait om waarschijnlijkheden: gegeven enkele woorden, welk woord volgt het meest waarschijnlijk? Dit idee sluit aan bij andere concepten die op waarschijnlijkheid steunen, zoals het trekken van een gekleurde bal uit een set ballen. We hebben in Hoofdstuk 2 over waarschijnlijkheden geleerd en kunnen ze nu toepassen!

Neem de zin: “The cat sat on the ___”. Een goed model rangschikt “mat” hoger dan “elephant", maar laat ook “sofa”, “roof” of “keyboard” toe, afhankelijk van de context. Om zulke voorspellingen te doen, moet het model begrijpen:

- Grammatica: “the” wordt vaak gevolgd door een zelfstandig naamwoord of bijvoeglijk naamwoord.

- Betekenis: katten zitten meestal op vaste objecten.

- Wereldkennis: katten en meubels komen vaak samen voor.

- Context: buiten vs. binnen verandert wat het beste past.

Dit eenvoudige raadspel vangt de essentie van hoe machines taal leren. Maar hoe kunnen we de volgende woorden betrouwbaar voorspellen?

N-Grams: De Eerste Stap

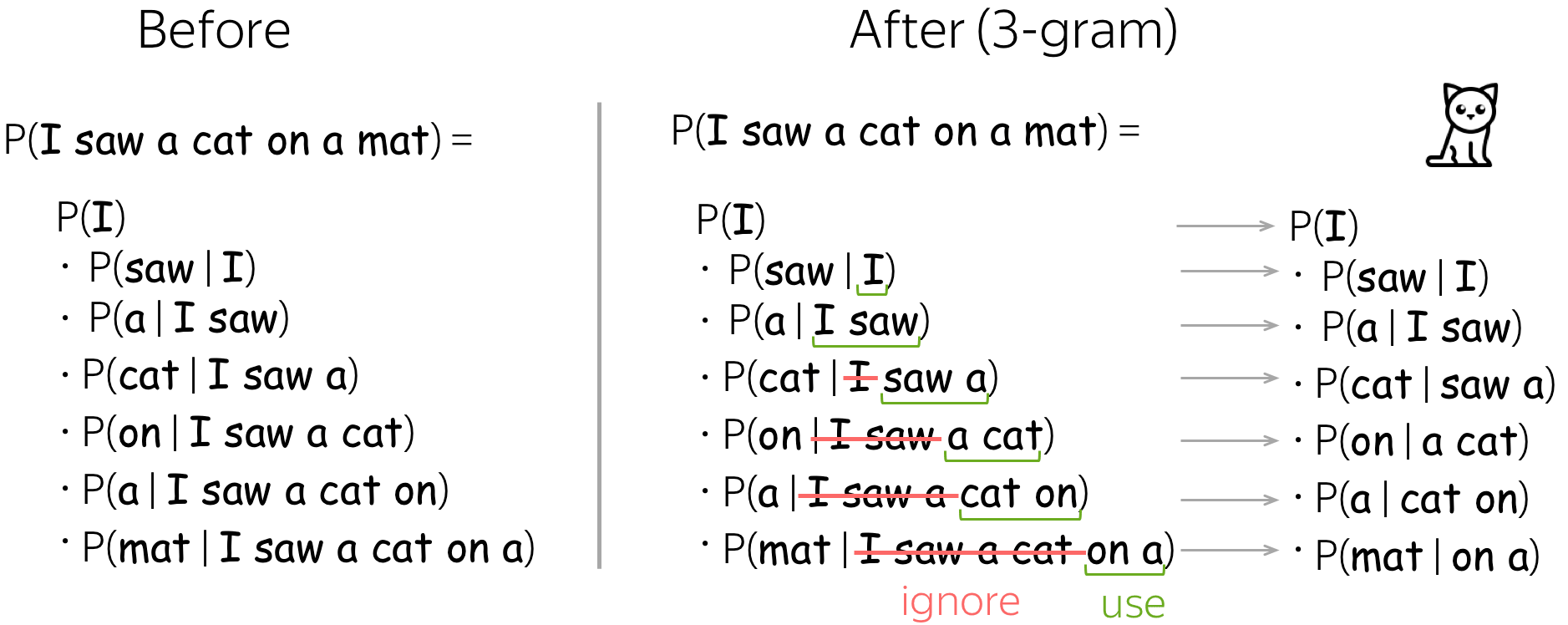

Vóór moderne neurale netwerken vertrouwden vroege taalmodellen op n-grams—eenvoudige statistieken over korte woordreeksen. Het idee is eenvoudig: hoe vaker een woord een ander woord volgt in de trainingstekst, hoe waarschijnlijker het voorspeld moet worden.

- Een bigram-model (n=2) voorspelt het volgende woord met alleen het vorige. Als “the” 1000 keer gevolgd wordt door “cat” en 500 keer door “dog”, kent het model een hogere waarschijnlijkheid toe aan “cat” na “the”.

- Een trigram-model (n=3) kijkt twee woorden terug. Na “the cat” voorspelt het mogelijk sterk “sat”, omdat die frase vaak voorkomt in de trainingsdata.

- Modellen met hogere orde (4-gram, 5-gram, enz.) kunnen meer geschiedenis meenemen maar worden moeilijker te beheren.

Het resultaat kan er ongeveer zo uitzien:

Zo worden ze getraind:

- Verzamel een grote tekstdataset.

- Breek die op in n-grams (reeksen van n woorden).

- Tel hoe vaak elke reeks voorkomt.

- Zet tellingen om in waarschijnlijkheden voor voorspelling.

N-grams klinken goed, maar hebben belangrijke beperkingen:

- Korte geheugenspanne: N-grams kijken maar enkele woorden terug. Ze kunnen geen lang-afstandsrelaties vatten, zoals een onderwerp aan het begin van een alinea koppelen aan een werkwoord veel later.

- Dataschaarste: Het aantal mogelijke reeksen groeit snel met n. De meeste langere combinaties komen nooit voor in training, waardoor het model worstelt met onbekende frasen.

- Inefficiëntie: Het opslaan van tellingen voor miljoenen n-grams kost enorme hoeveelheden geheugen, vooral wanneer de meeste combinaties zeldzaam zijn.

N-grams waren een belangrijke eerste stap: ze toonden aan dat statistiek taal nuttig kan modelleren. Maar hun beperkingen duwden onderzoekers in de richting van flexibelere methoden—uiteindelijk leidend tot neurale taalmodellen.

Neurale Taalmodellen

Om de beperkingen van n-grams te overwinnen, wendden onderzoekers zich tot neurale netwerken. In plaats van alleen te tellen hoe vaak woorden samen voorkomen, representeren deze modellen woorden als embeddings (vectoren die betekenis vastleggen) en voeren ze die in een netwerk dat bredere patronen leert.

Dit stelt het model in staat te generaliseren voorbij exacte overeenkomsten. Als het bijvoorbeeld heeft gezien:

- “The dog ran quickly”

- “The cat walked slowly”

…kan het nog steeds een goede gok doen voor “The rabbit moved ___”, zelfs als die zin nooit in training voorkwam. Het model herkent de gelijkenis tussen “dog”, “cat” en “rabbit”, evenals tussen “ran”, “walked” en “moved”.

Een andere doorbraak is langer geheugen. Terwijl n-grams maar enkele woorden terugkeken, kunnen neurale modellen tientallen, honderden of zelfs duizenden woorden meenemen. Dit maakt het mogelijk om consistent te blijven over alinea’s, onderwerpen in essays vast te houden of personages in een verhaal te behouden.

Kortom, neurale taalmodellen memoriseren niet simpelweg reeksen—ze bouwen flexibele representaties die hen in staat stellen nieuwe combinaties en langere contexten aan te kunnen.

Van Voorspelling Naar Mogelijkheden

Opmerkelijk is wat er gebeurt wanneer deze modellen opschalen—getraind op enorme tekstcollecties met grotere netwerken. Uit de eenvoudige taak van volgende-woordvoorspelling ontstaan onverwachte bekwaamheden.

- Vragen beantwoorden: Een model dat “The capital of France is ___” met “Paris” leert aanvullen, leert uiteindelijk allerlei feitelijke vragen te beantwoorden, zelfs wanneer ze anders geformuleerd zijn.

- Vertaling: Door meertalige teksten naast elkaar te zien, pikken modellen op hoe woorden in de ene taal naar de andere mappen, zonder dat dit expliciet is aangeleerd.

- Wiskunde en logica: Bij blootstelling aan wiskundige uitdrukkingen in tekst leren modellen dat en breiden dat uit naar andere rekenproblemen. Ze doen geen wiskunde zoals een rekenmachine, maar herkennen en vervolgen patronen.

- Programmeren: Getraind op coderepositories leren modellen functies autocompleten, syntaxisfouten herstellen of zelfs nieuwe code schrijven.

- Gezond verstand: Door alledaagse taal te absorberen, leiden modellen patronen af zoals “ijs is koud” of “mensen hebben voedsel nodig”. Dit zijn geen feiten in een database—het zijn statistische regelmatigheden uit tekst.

Cruciaal is dat geen van deze vaardigheden direct is geprogrammeerd. Ze ontstaan natuurlijk omdat voorspellend trainen op schaal het model dwingt grammatica, betekenis en wereldkennis te vatten. Dit was het moment waarop taalmodellen verschoof van simpele tekstvoorspellers naar systemen die lijken te kunnen redeneren, feiten reproduceren en nuttige antwoorden genereren.

De Schaalrevolutie

Een van de grootste ontdekkingen in AI is dat taalmodellen simpelweg beter worden door opschaling. Wanneer modellen in omvang groeien, op meer data worden getraind en meer rekenkracht gebruiken, verbeteren hun capaciteiten op een verrassend vloeiende en voorspelbare manier.

- Vroege neurale modellen in de jaren 2010 hadden slechts enkele miljoenen parameters—genoeg om lokale patronen te vatten, maar beperkt van reikwijdte.

- GPT-1 (2018): 117 miljoen parameters, toonde dat training op grote schaal samenhangende tekst kan opleveren.

- GPT-2 (2019): 1,5 miljard parameters, met outputs die echt menselijk begonnen te lijken.

- GPT-3 (2020): 175 miljard parameters, in staat om essays, code en gesprekken te genereren die zelfs onderzoekers verrasten.

- Moderne grensmodellen bereiken nu honderden miljarden tot triljoenen parameters.

Minstens zo belangrijk is de trainingsdata. Vroege modellen werden getraind op samengestelde collecties zoals nieuwsartikelen of Wikipedia. De grote modellen van vandaag leren van enorme dwarsdoorsneden van het internet—boeken, wetenschappelijke papers, websites, fora en meer. Deze diversiteit stelt ze bloot aan bijna elk onderwerp waarover mensen schrijven, van kookrecepten tot kwantumfysica.

De combinatie van omvang, data en compute heeft language modeling getransformeerd van een simpele autocomplete-tool naar systemen die lange, samenhangende gesprekken, probleemoplossing en creatieve taken aankunnen. Deze ontwikkeling wordt vaak de schaalrevolutie genoemd, omdat ze laat zien dat alleen opschaling nieuwe, onverwachte capaciteiten kan ontsluiten.

Conversatie En Verder

In de kern is zelfs ChatGPT nog steeds “gewoon” een taalmodel dat het volgende woord voorspelt. Wat het conversatiever maakt, is het fine-tuning-proces: nadat het is getraind op tekst op internetschaal, wordt het verder getraind op dialoogvoorbeelden en menselijke feedback. Dit stuurt het aan om reacties te genereren die niet alleen grammaticaal zijn, maar ook behulpzaam, beleefd en coherent in gesprek. Dit verklaart zowel de sterke punten als de beperkingen:

- Sterke punten: ChatGPT kan concepten uitleggen, verhalen schrijven of vragen beantwoorden op een natuurlijke, conversatiegerichte manier. Het past toon en stijl aan afhankelijk van hoe je je prompt formuleert.

- Beperkingen: Het “weet” geen feiten zoals mensen. Het zoekt geen informatie real-time op, maar voorspelt tekst op basis van patronen in de trainingsdata. Dit betekent dat het overtuigende maar verouderde of onjuiste antwoorden kan produceren.

Modernere taalmodellen worden uitgebreid tot de producten die we vandaag gebruiken:

- Multimodale modellen: Modellen die tekst combineren met beelden, audio of video. Zo kan een model beschrijven wat er op een afbeelding staat, een beeld genereren uit een tekstprompt of zelfs een gesproken dialoog voeren.

- Toolgebruik: Sommige modellen leren externe tools aan te roepen—zoals een rekenmachine voor wiskunde, een zoekmachine voor actuele informatie of een database voor precieze feiten. Dit helpt de grenzen van alleen voorspellen te overwinnen.

Samen markeren deze vooruitgangen de verschuiving van pure tekstvoorspelling naar AI-systemen die op rijkere, betrouwbaardere en veelzijdigere manieren met de wereld interacteren.

Belangrijkste Inzichten

Language modeling—het voorspellen van het volgende woord—blijft de basis van AI-systemen. Van vroege n-gramtellingen tot massieve neurale netwerken heeft deze taak bewezen krachtig genoeg te zijn om grammatica, betekenis, kennis en zelfs redeneringachtige vermogens te ontsluiten.

Moderne modellen laten zien dat door op schaal te leren menselijke tekst te voorspellen, machines reacties kunnen genereren die intelligent aanvoelen—ook al spelen ze in de kern nog steeds ’s werelds meest geavanceerde raadspel.