Elk woord een eenvoudig ID-nummer geven, zoals “kat" = 4, vertelt ons niets over betekenis. “Kat” (4) lijkt net zo dichtbij “auto” (6) als bij "hond” (5), terwijl katten en honden in werkelijkheid veel meer met elkaar te maken hebben.

Word embeddings lossen dit op. In plaats van enkele getallen, representeren ze woorden als vectoren—lijsten met getallen—zodat woorden met vergelijkbare betekenissen dicht bij elkaar eindigen in een wiskundige ruimte (maar dat weet je al uit Hoofdstuk 2!). Deze simpele verschuiving maakte moderne taal-AI mogelijk.

Van Enkele Getallen Naar Vectorrepresentaties

In plaats van "kat" te representeren als gewoon het getal 4, kun je het voorstellen als een vector zoals:

Deze vector kan 100, 300 of zelfs 1000 dimensies hebben, waarbij elke dimensie een aspect van de betekenis van het woord vastlegt.

De exacte betekenis van elke dimensie is niet altijd duidelijk voor mensen, maar het algemene patroon legt semantische eigenschappen vast. Het belangrijkste inzicht is dat woorden met vergelijkbare betekenissen vergelijkbare vectoren krijgen.

Kijk hoe we een paar gerelateerde woorden kunnen representeren:

- "cat" → .

- "dog" → .

- "kitten" → .

- "car" → .

Let op hoe "cat", "dog" en "kitten" op veel dimensies vergelijkbare waarden hebben, terwijl "car" heel andere waarden heeft. Deze wiskundige gelijkenis weerspiegelt semantische gelijkenis.

Word2Vec: Relaties Leren Uit Context

De bekendste methode om embeddings te leren is Word2Vec, ontwikkeld bij Google. Het kernidee: je kent een woord aan het gezelschap dat het houdt.

Het model traint op tekst door een woord te voorspellen uit zijn omliggende context, of de context gegeven een woord.

🦾 Voorbeeld van Trainingsproces:

Neem de zin "The fluffy cat sat on the mat". Het Word2Vec-algoritme kan leren door te proberen "cat" te voorspellen op basis van de omliggende woorden , of juist de omliggende woorden voorspellen gegeven "cat". Door miljoenen van zulke voorbeelden leert het netwerk dat woorden die in vergelijkbare contexten voorkomen vergelijkbare representaties moeten hebben.

Tijdens training op enorme tekstcorpora komt het algoritme patronen tegen zoals:

- "The fluffy cat..." en "The fluffy dog..." (katten en honden verschijnen in vergelijkbare contexten).

- "...ran quickly" en "...walked slowly" (bewegingswerkwoorden delen contexten).

- "Paris, France" en "London, England" (steden en landen komen samen voor).

Deze contextuele patronen worden gecodeerd in de vectorrepresentaties, zodat semantisch vergelijkbare woorden wiskundig dicht bij elkaar eindigen in de embedding space.

De Geometrie Van Betekenis

Zodra we word embeddings hebben, kunnen we wiskundige operaties gebruiken om semantische relaties te verkennen. De afstand tussen vectoren weerspiegelt semantische gelijkenis—dichtere vectoren representeren meer vergelijkbare woorden.

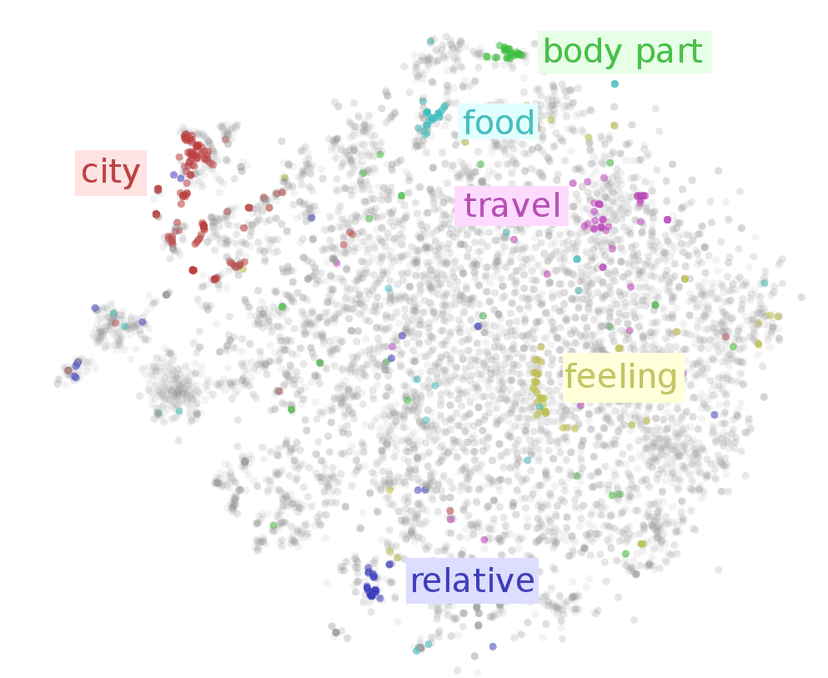

Net zoals bij clustering in het winkelgedragvoorbeeld in Hoofdstuk 3, groeperen dieren zich, clusteren emoties bij elkaar, vormen landen hun eigen regio en verzamelen werkwoorden zich in een ander gebied. Kijk eens naar enkele woordclusters in embedding space:

Deze clustering gebeurt automatisch—we hebben het algoritme nooit verteld dat "cat" en "dog" allebei dieren zijn, of dat "happy" en "joyful" allebei emoties zijn. Het algoritme ontdekte deze relaties door te observeren welke woorden in vergelijkbare contexten voorkomen in miljoenen zinnen, dus dit is een voorbeeld van unsupervised learning!

Vectorrekenkunde: De Magie Van Woordenwiskunde

Misschien wel de meest fascinerende eigenschap van word embeddings is dat betekenisvolle rekenkundige operaties werken in de vectorruimte. Een beroemd voorbeeld is: king - man + woman ≈ queen.

Dit werkt omdat de embeddings relationele patronen vastleggen. Het vectorverschil tussen "king" en "man" representeert iets als "royalty" of "monarchale rol". Wanneer we "woman" aan dit verschil toevoegen, krijgen we een vector dichtbij "queen"—het vrouwelijke equivalent van een koning.

Meer Voorbeelden Van Woordenrekenkunde:

- Paris - France + Italy ≈ Rome (hoofdsteden).

- Walking - Walk + Swim ≈ Swimming (werkwoordsvormen).

- Bigger - Big + Small ≈ Smaller (vergrotende trap).

- Apple - Fruit + Vegetable ≈ Carrot (categorierelaties).

Deze relaties ontstaan vanzelf uit het trainingsproces. Het algoritme leert nooit expliciet dat Parijs zich tot Frankrijk verhoudt zoals Rome tot Italië, maar door deze woorden in vergelijkbare contexten in veel documenten te zien, codeert het deze analogische relaties in de wiskundige structuur van de embeddings.

Voorbij Individuele Woorden

Moderne embeddings leggen nog veel geavanceerdere relaties vast dan simpele woordgelijkenissen en analogieën. Ze coderen culturele associaties, temporele relaties en zelfs subtiele vooroordelen die aanwezig zijn in de trainingsdata.

Culturele En Contextuele Associaties:

Woorden die verbonden zijn met bepaalde beroepen, activiteiten of concepten clusteren samen op manieren die echte wereldassociaties weerspiegelen. "Doctor" staat mogelijk dichter bij "hospital" en "surgery", terwijl "teacher" clustert bij "classroom" en "students".

Omgaan Met Meerdere Betekenissen:

Geavanceerde embedding-methoden kunnen zelfs omgaan met woorden met meerdere betekenissen. Het woord "bank" kan verschillende representaties hebben afhankelijk van of het verschijnt in financiële contexten ("money", "loan", "account") of geografische contexten ("river", "shore", "water").

Temporele En Stilistische Variaties:

Embeddings die getraind zijn op verschillende tijdsperioden of tekstbronnen leggen vast hoe taal evolueert en varieert. Woorden kunnen andere associaties hebben in 19e-eeuwse literatuur dan in moderne socialemediaberichten.

Zelf Embeddings Trainen

Hoewel voorgetrainde embeddings zoals Word2Vec, GloVe of FastText goed werken voor veel toepassingen, heb je soms embeddings nodig die getraind zijn op specifieke domeinteksten.

Het Trainingsproces:

- Verzamel een groot corpus aan tekst uit jouw domein.

- Preprocess en tokenize de tekst.

- Train het embedding-model met algoritmen zoals Word2Vec of GloVe.

- Evalueer de resulterende embeddings op kwaliteit en relevantie.

- Fine-tune parameters indien nodig.

Domeinspecifieke Voordelen:

Medische embeddings die getraind zijn op medische literatuur begrijpen dat "myocardial infarction" en "heart attack" synoniemen zijn, terwijl algemene embeddings deze connectie mogelijk missen. Juridische embeddings begrijpen relaties tussen juridische termen die algemene embeddings niet vastleggen.

Beperkingen En Uitdagingen

Ondanks hun kracht hebben word embeddings belangrijke nadelen.

Statistische betekenis: Klassieke embeddings geven elk woord één vector. “Bank” heeft dezelfde representatie of het nu over geld of een rivier gaat, wat het moeilijk maakt om genuanceerde context vast te leggen.

Bias: Omdat embeddings leren van menselijke tekst, nemen ze ook menselijke stereotypen over—zoals “doctor” vaker met mannen dan met vrouwen associëren. Deze biases kunnen terugkomen in AI-systemen die ze gebruiken.

Dekkingsgaten: Woorden die ontbreken in de trainingsdata—nieuwe slang, zeldzame technische termen of unieke namen—kunnen niet goed worden gerepresenteerd.

Resource-eisen: Embeddings trainen vereist grote datasets en veel rekenkracht. Het opslaan van miljoenen hoog-dimensionale vectoren kost ook veel geheugen.

De Basis Voor Moderne NLP

Word embeddings waren een keerpunt in natural language processing. Voor het eerst konden computers woorden representeren op een manier die betekenis weerspiegelde in plaats van alleen labels. Deze verschuiving maakte alles mogelijk, van eenvoudige text classification tot de grote taalmodellen die we vandaag gebruiken.

Het kernidee is simpel maar krachtig: patronen in hoe woorden samen voorkomen bevatten informatie over hun betekenis. Embeddings legden dit wiskundig vast en effenden de weg voor geavanceerdere systemen. Moderne modellen gebruiken nu contextuele embeddings die woordbetekenis aanpassen aan de omliggende tekst, maar ze bouwen nog steeds voort op hetzelfde principe: semantische relaties kunnen uit data geleerd worden en gerepresenteerd als vectoren.

Belangrijkste Inzichten

Embeddings transformeren woorden van willekeurige ID’s naar vectoren waarbij afstand betekenis weerspiegelt. Door te trainen op context ontdekten methoden zoals Word2Vec dat gerelateerde woorden samen clusteren en zelfs analogieën ondersteunen via vectorrekenkunde.

Hoewel beperkt—statische embeddings kunnen zich niet aanpassen aan context en nemen bias over—vormden ze de eerste echte brug tussen ruwe tekst en wiskundige structuur. Dit inzicht legde de basis voor de AI van vandaag en liet zien dat betekenis kan worden gecodeerd in getallen en gemanipuleerd om taken uit te voeren zoals vertaling, samenvatting en vraagbeantwoording.