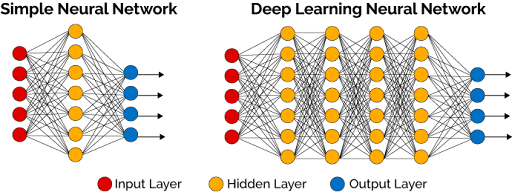

We hebben gezien hoe multi-layer-perceptrons problemen kunnen oplossen die enkele perceptrons niet aankunnen. Maar de netwerken die de AI-doorbraken van vandaag aansturen—systemen die gezichten herkennen, talen vertalen en kunst genereren—gaan veel dieper. Deze "deep neural networks" gebruiken dezelfde basisprincipes als MLP’s, maar schalen die dramatisch op.

Het verschil tussen een basis-MLP en een deep neural network is niet fundamenteel nieuwe technologie—het gaat om schaal, diepte en de emergente capaciteiten die ontstaan wanneer je veel lagen op elkaar stapelt. Dit schaalproces begrijpen helpt verklaren waarom moderne AI zo krachtig is geworden en waarom de term "Deep Learning" de essentie van de huidige AI-revolutie vangt.

Wat Maakt een Neuraal Netwerk "Diep"?

De overgang van MLP’s naar deep neural networks draait voornamelijk om het toevoegen van meer verborgen lagen, maar deze eenvoudige verandering creëert diepgaande verschillen in capaciteit. Laten we eerst een definitie voor "diep" vinden:

- Ondiepe netwerken: 1-2 verborgen lagen (traditionele MLP’s).

- Diepe netwerken: 3+ verborgen lagen (moderne DL).

- Zeer diepe netwerken: 50-1000+ lagen (state-of-the-art onderzoek).

Hoewel een 3-lagen-MLP en een 10-lagen deep network dezelfde basiscomponenten gebruiken (perceptrons, gewichten, activatiefuncties), kan het deep network exponentieel complexere patronen leren. Het is als het verschil tussen een eenvoudig gereedschap en een geavanceerde machine—dezelfde basisprincipes, maar enorme verschillen in mogelijkheden.

Deze diepte stelt moderne neurale netwerken in staat om ingewikkelde structuren in data vast te leggen en doorbraken te realiseren in visie, taal en vele andere domeinen.

Hiërarchisch Feature Learning: Het Voordeel van Diepte

Diepe netwerken blinken uit in het automatisch ontdekken van hiërarchische representaties—ze leren complexe patronen te herkennen door ze op te bouwen uit eenvoudigere componenten.

🐱 Hiërarchie Voor Beeldherkenning Voorbeeld: Laten we volgen hoe een diep netwerk een foto van een kat verwerkt:

Laag 1 (laag-niveau features) detecteert basale visuele elementen:

- Horizontale lijnen, verticale lijnen, diagonale randen.

- Kleurgradiënten en veranderingen in helderheid.

- Eenvoudige geometrische vormen.

Lagen 2-3 (midden-niveau features) combineren basiselementen tot betekenisvolle delen:

- Bochten en hoeken door lijnsegmenten te combineren.

- Texturen zoals vacht of gladde oppervlakken.

- Eenvoudige vormen zoals cirkels en driehoeken.

Lagen 4-5 (hoog-niveau features) herkennen complexe objectdelen:

- Ogen (combinatie van bochten, texturen en kleurpatronen).

- Oren (driehoekige vormen met specifieke texturen).

- Gelaatskenmerken en lichaamsdelen.

Laag 6+ (objectherkenning) voegt delen samen tot complete concepten:

- "Deze combinatie van features stelt een kat voor".

- "De kat zit" of "de kat is oranje".

Op deze manier transformeren diepe netwerken ruwe input in gelaagde abstracties, waardoor ze complexe patronen met opmerkelijke nauwkeurigheid kunnen herkennen en erover kunnen redeneren.

Waarom Diepte Ertoe Doet

Vanuit wiskundig perspectief zorgt het toevoegen van lagen voor exponentiële toename in de soorten functies die het netwerk kan representeren. Functies kunnen complexer worden:

- 1 laag: Kan alleen lineaire beslissingsgrenzen maken (zoals onze oorspronkelijke perceptron).

- 2 lagen: Kan elke continue functie benaderen (universele approximatie).

- 3+ lagen: Kan dezelfde functies met minder neuronen representeren, plus hiërarchische structuur natuurlijker vastleggen.

✍🏼 Voorbeeld Handgeschreven Cijfers: Beschouw opnieuw het herkennen van handgeschreven cijfers. Een ondiep netwerk heeft misschien duizenden neuronen nodig om pixelpatronen direct op cijfers te mappen. Een diep netwerk kan minder totale neuronen gebruiken door begrip op te bouwen:

- Laag 1: 100 neuronen die strekpatronen detecteren.

- Laag 2: 50 neuronen die streken combineren tot cijferdelen.

- Laag 3: 20 neuronen die complete cijfers herkennen.

Deze hiërarchische benadering is zowel efficiënter als beter te interpreteren.

Trainingsuitdagingen: De Prijs van Diepte

Lagen toevoegen creëert nieuwe uitdagingen die in ondiepe netwerken niet bestaan.

Het Vanishing Gradient-Problem: Zoals we in de volgende hoofdstukken zullen zien, leren diepe netwerken via backpropagation—foutsignalen worden achterwaarts door de lagen gestuurd. In zeer diepe netwerken kunnen deze signalen extreem klein worden tegen de tijd dat ze de vroege lagen bereiken, waardoor leren traag of onmogelijk wordt.

Rekenvereisten: State-of-the-art-modellen vereisen enorme rekenkracht:

- Geheugen: Diepe netwerken hebben veel RAM nodig om alle laagactivaties op te slaan.

- Verwerking: Meer lagen betekenen meer berekeningen per voorspelling.

- Trainingstijd: Diepe netwerken kunnen dagen of weken nodig hebben om goed te trainen.

Risico op Overfitting: Met miljoenen of miljarden parameters kunnen diepe netwerken trainingsdata gemakkelijk uit het hoofd leren in plaats van generaliseerbare patronen op te pikken. Dit vereist zorgvuldige regularisatie- en validatiestrategieën.

Hardware-Evolutie: De deep learning-revolutie werd mogelijk gemaakt door vooruitgang in rekenhardware zoals GPU’s en technieken zoals het gebruik van meerdere machines om zeer grote modellen te trainen.

De Deep Learning-Revolutie

De verschuiving van ondiepe naar diepe netwerken is een van de belangrijkste vooruitgangen in de AI-geschiedenis:

Voor deep learning (jaren 1990–2000):

- Handgemaakte features voor elk probleemdomein.

- Ondiepe netwerken met beperkte capaciteit.

- Prestaties stagneerden op complexe taken.

Deep learning-tijdperk (2010s-heden):

- Automatisch feature learning uit ruwe data.

- Doorbraakprestaties in visie, taal en games.

- Continue verbetering met meer data en compute.

De belangrijkste aanjagers van de revolutie:

- Betere algoritmen: Verbeterde trainingstechnieken en architecturen.

- Meer data: Datasets op internetschaal voor training.

- Rekenkracht: GPU’s en gespecialiseerde hardware.

- Softwareframeworks: Tools die deep learning toegankelijk maken.

Samen ontketenden deze factoren de deep learning-revolutie, die AI hervormde tot een veld dat problemen kan oplossen die ooit ver buiten bereik werden geacht.

Belangrijkste Inzichten

Diepe neurale netwerken breiden het multi-layer-perceptronconcept uit door veel meer verborgen lagen toe te voegen, waardoor automatische ontdekking van hiërarchische featurerepresentaties mogelijk wordt. Deze diepte stelt netwerken in staat complexe problemen op te splitsen in beheersbare subproblemen en patronen op meerdere abstractieniveaus te leren herkennen. Hoewel de basiscomponenten hetzelfde blijven—neuronen, gewichten en activatiefuncties—overtreffen de emergente capaciteiten van diepe netwerken die van ondiepe architecturen ruimschoots.

Deze kracht gaat echter gepaard met grotere rekenvereisten en trainingsuitdagingen die geavanceerde technieken vereisen om te overwinnen. Het begrijpen van de principes van diepe netwerken geeft inzicht in waarom moderne AI-systemen zo capabel zijn en hoe ze verschillen van eerdere, eenvoudigere benaderingen van machine learning.