Voordat we duiken in complexe neurale netwerken, moeten we hun meest basale component begrijpen: de perceptron. Zie het als de baksteen van Deep Learning (DL)—op zichzelf eenvoudig, maar in slimme combinaties in staat om ongelooflijk geavanceerde systemen te bouwen.

De perceptron werd in 1957 uitgevonden en vertegenwoordigt een van de eerste pogingen om na te bootsen hoe neuronen in de hersenen werken. Hoewel een enkele perceptron beperkt is, geeft het begrijpen van hoe hij informatie verwerkt en leert van fouten je de basis om moderne AI-systemen zoals ChatGPT en beeldherkenningsnetwerken te doorgronden.

Wat Is Een Perceptron?

Een perceptron is geïnspireerd op biologische neuronen in je hersenen. Net zoals een neuron signalen ontvangt van andere neuronen en "vuurt" als het gecombineerde signaal sterk genoeg is, ontvangt een perceptron numerieke inputs, verwerkt die, en produceert een eenvoudige ja- of nee-beslissing.

Een perceptron implementeert een specifiek type functie:

Je zou veel van deze formule moeten herkennen, maar laten we de componenten ontleden:

- zijn inputwaarden (zoals features die we leerden in Machine Learning).

- zijn gewichten (het belang van elke input).

- is opnieuw de bias-term.

- vertegenwoordigt de output (1 voor "ja", 0 voor "nee").

Het proces verloopt als volgt:

- Neem elke input en vermenigvuldig die met het bijbehorende gewicht.

- Tel alle gewogen inputs op.

- Voeg de bias-term toe.

- Als het totaal positief is, output 1; als het negatief of nul is, output 0.

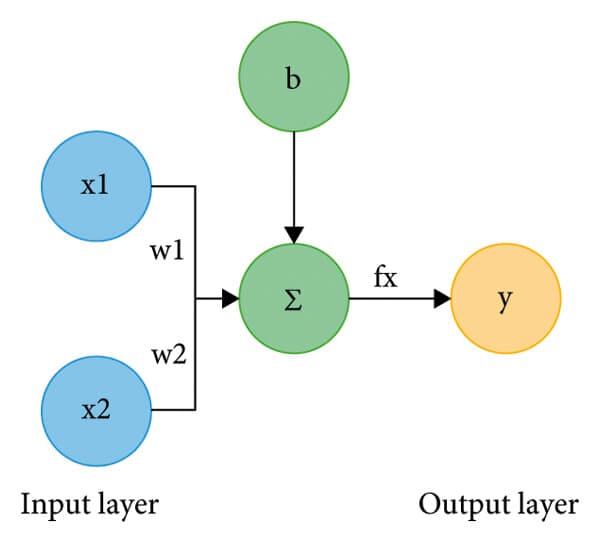

Bekijk het onderstaande diagram:

Elke input wordt vermenigvuldigd met een gewicht, de resultaten worden opgeteld (aangeduid met ), en de perceptron beslist of het totaal hoog genoeg is om te “vuren”.

Een Praktisch Voorbeeld: Moet Je Gaan Hardlopen?

Laten we dit concreet maken met een beslissing waar je voor kunt staan: of je gaat hardlopen. Stel dat we de volgende gegevens hebben verzameld die relevant kunnen zijn:

- Kwaliteit van het weer (0-10): (mooie dag).

- Beschikbare tijd (uren): (wat tijd beschikbaar).

- Energieniveau (0-10): (redelijk energiek).

Door ervaring heb je geleerd dat:

- (weer doet ertoe, maar is niet alles).

- (tijd is heel belangrijk).

- (energieniveau telt matig mee).

- (je blijft over het algemeen liever binnen, dus je moet overtuigd worden).

Met de logica van de perceptron kunnen we een berekening maken:

Omdat , geeft de perceptron 1 als output dus laten we gaan hardlopen!

Dit laat zien hoe de perceptron verschillende factoren weegt en een binaire beslissing maakt op basis van het gecombineerde bewijs.

Leren Door Voorbeelden

Laten we zien hoe een perceptron leert om in de loop van de tijd betere voorspellingen te doen met een ander voorbeeld. We voorspellen of een student een examen zal halen op basis van:

- Uren gestudeerd ().

- Uren geslapen de nacht ervoor ().

We wijzen gewichten toe (willekeurig), onthoud dat elke feature zijn eigen gewicht heeft:

- .

- .

- Vergeet de bias niet .

We kunnen ons initiële model testen: als een student 3 uur studeerde en 5 uur sliep:

Omdat geeft de perceptron 1 terug en slaagt de student. Als de student daadwerkelijk slaagde, was onze voorspelling correct! Maar als hij faalde, moeten we onze gewichten aanpassen.

Wanneer de perceptron een fout maakt, past hij de gewichten aan in de richting die de juiste voorspelling zou hebben opgeleverd. Dit lijkt op het gradient descent-concept dat we leerden in Hoofdstuk 3, maar dan eenvoudiger.

- Als we "geslaagd" voorspelden maar de student faalde → verlaag gewichten die bijdroegen aan de hoge score.

- Als we "gezakt" voorspelden maar de student slaagde → verhoog gewichten die meer hadden moeten bijdragen.

Na veel voorbeelden vindt de perceptron gewichten die fouten minimaliseren—net als het optimalisatieproces dat we zagen in machine learning!

Wat Perceptrons Wel En Niet Kunnen

Perceptrons zijn krachtig voor bepaalde soorten problemen, maar hebben belangrijke beperkingen. Ze zijn goed in:

- Lineaire classificatie: Problemen waarbij je een rechte lijn kunt trekken om categorieën te scheiden.

- AND/OR-logica: Eenvoudige logische operaties.

- Binaire beslissingen: Elke ja/nee-classificatie met lineair scheidbare data.

😈 Het XOR-Problem: De klassieke beperking van perceptrons is het XOR (exclusive or)-probleem, bekijk de volgende datapunten:

- (0,0) → cirkel

- (0,1) → ster

- (1,0) → ster

- (1,1) → cirkel

Neem even de tijd om na te denken hoe ze eruitzien in een rooster. Hoe kunnen we de klassen "ster" en "cirkel" scheiden met een rechte lijn?

Geen enkele rechte lijn kan de sterren van de cirkels scheiden in dit patroon. Deze beperking dreef onderzoekers ertoe om multi-layer-netwerken te ontwikkelen, die we hierna zullen verkennen.

Enkele beperkingen van de perceptron in de echte wereld:

- Beeldherkenning: Een enkele perceptron kan geen complexe visuele patronen herkennen

- Taalbegrip: Betekenis van zinnen omvat niet-lineaire relaties tussen woorden

- Complexe besluitvorming: De meeste echte problemen vereisen het overwegen van interacties tussen features

Kortom, hoewel perceptrons de basis legden van neurale netwerken, laten hun beperkingen zien waarom diepere architecturen essentieel zijn voor het oplossen van complexe, realistische problemen.

Historische Betekenis

De perceptron, uitgevonden door Frank Rosenblatt in 1957, was een van de eerste machine learning-algoritmen die van data konden leren. Vroege demonstraties lieten zien dat perceptrons eenvoudige patronen konden leren herkennen, wat enorme opwinding veroorzaakte over kunstmatige intelligentie.

Toen onderzoekers echter bewezen dat perceptrons problemen zoals XOR niet konden oplossen, nam de interesse in neurale netwerken decennia lang af. Deze periode, bekend als de "AI-winter," duurde totdat onderzoekers uitvonden hoe ze multi-layer-netwerken effectief konden trainen.

Vandaag de dag blijft de perceptron het fundamentele bouwblok van modern deep learning. Elke neuron in ChatGPT, beeldherkenningssystemen en andere AI-toepassingen is in wezen een meer geavanceerde versie van het oorspronkelijke perceptronconcept.

Connectie Met Moderne AI

Hoewel eenvoudig, introduceerden perceptrons verschillende concepten die nog steeds centraal staan in moderne AI:

Gewichtsleren: Het idee dat AI-systemen passende featuregewichten uit data moeten leren in plaats van dat ze met de hand gecodeerd worden.

Drempelbeslissingen: Het concept om meerdere inputs te combineren om binaire beslissingen te nemen, hoewel moderne systemen meer geavanceerde activatiefuncties gebruiken.

Iteratieve Verbetering: Het principe dat AI-systemen verbeteren door herhaalde blootstelling aan trainingsvoorbeelden en foutcorrectie.

Het begrijpen van perceptrons helpt je waarderen dat zelfs de meest geavanceerde AI-systemen zijn opgebouwd uit relatief eenvoudige wiskundige operaties, miljoenen of miljarden keren herhaald.

Belangrijkste Inzichten

De perceptron vertegenwoordigt de fundamentele rekeneenheid in neurale netwerken—een eenvoudige wiskundige functie die inputs weegt en binaire beslissingen maakt. Hoewel beperkt tot lineair scheidbare problemen, introduceerden perceptrons de kernprincipes van leren uit data via gewichtsaanpassing en iteratieve foutcorrectie. Hun historische betekenis ligt niet alleen in hun mogelijkheden, maar ook in het aantonen dat machines konden leren beslissingen te maken uit voorbeelden in plaats van expliciete programmering.

Het begrijpen van perceptrons biedt de conceptuele basis om te begrijpen hoe complexe moderne AI-systemen werken, aangezien ze in wezen geavanceerde netwerken zijn van onderling verbonden perceptronachtige eenheden die samenwerken om complexe problemen op te lossen.