Machine Learning lijkt misschien mysterieus, maar het volgt een verrassend systematisch proces. In tegenstelling tot mensen, die leren door begrip en intuïtie, leren machines door hun interne instellingen wiskundig aan te passen zodat ze na verloop van tijd betere voorspellingen kunnen doen.

Zie het als het stemmen van een gitaar—je begint met willekeurige snaarspanningen, luistert hoe het klinkt en past vervolgens elke snaar geleidelijk aan totdat je de juiste toon krijgt. Machine learning werkt op een vergelijkbare manier: begin met willekeurige wiskundige instellingen, controleer hoe goed ze werken en pas ze dan stap voor stap aan totdat je nauwkeurige voorspellingen krijgt.

Het volledige leerproces valt uiteen in vier essentiële stappen: het omzetten van echte wereldinformatie in getallen, het kiezen van het juiste type wiskundige functie, het trainen van die functie om fouten te minimaliseren en het testen of het werkt op nieuwe voorbeelden.

Stap 1: De Wereld Weergeven Als Data

Voordat er geleerd kan worden, moeten we rommelige echte wereldinformatie vertalen naar schone numerieke data die computers wiskundig kunnen verwerken.

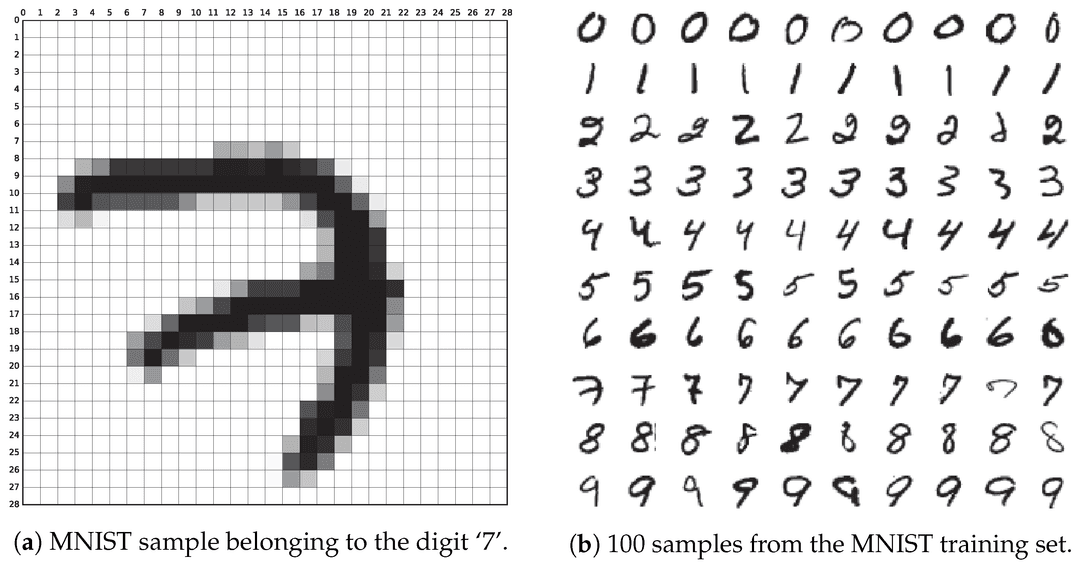

✏️ Voorbeeld Handgeschreven Cijferherkenning: Een van de bekendste voorbeelden in Machine Learning is het herkennen van handgeschreven cijfers uit de MNIST-dataset. Jij ziet misschien direct dat een krabbel een "7" is, maar computers zien afbeeldingen niet op die manier.

In plaats daarvan wordt elke pixelafbeelding een matrix van 784 getallen, waarbij elk getal aangeeft hoe helder die pixel is (0 = zwart, 255 = wit):

Wat voor ons een simpele "7" lijkt, wordt voor de computer een matrix zoals deze:

Elke rij vertegenwoordigt een deel van de afbeelding, en deze 784 getallen worden de input voor het machine learning-model.

Verschillende soorten data hebben verschillende representaties:

- Tekst: Woorden worden omgezet naar numerieke codes of "embeddings" die betekenis vastleggen.

- Audio: Geluidsgolven worden reeksen frequentiemetingen.

- Financiële data: Aandelenkoersen, handelsvolumes en marktindicatoren zijn al getallen.

- Medische data: Symptomen, testresultaten en metingen worden gestandaardiseerd naar numerieke schalen.

Maar wat doen we met niet-numerieke categorieën zoals "spam," "promotie" of "inbox"? Als we e-mails in meerdere categorieën willen classificeren, kunnen we tekstlabels niet rechtstreeks invoeren. In plaats daarvan representeren we ze als numerieke vectoren:

| Label | Numerieke Code |

|---|---|

| Spam | (1, 0, 0) |

| Promoties | (0, 1, 0) |

| Inbox | (0, 0, 1) |

Elke categorie krijgt zijn eigen positie in een vector, met een 1 op de juiste plaats en 0’s elders. Deze techniek heet one-hot encoding. Zo kunnen we categorieën omzetten naar getallen waar wiskundige functies mee kunnen werken.

Stap 2: Het Kiezen Van Een Wiskundige Functie

Machine learning draait in essentie om het vinden van de beste functie die inputs naar outputs vertaalt:

- Als een e-mail is, kan spam of geen spam zijn.

- Als een afbeelding is, kan een kat of hond zijn.

- Als een huis is, kan de voorspelde prijs zijn.

De grootste uitdaging is het kiezen van het juiste functietype. Verschillende problemen vragen om verschillende wiskundige benaderingen.

🏠 Voorbeeld Lineaire Functie: Stel dat we huizenprijzen willen voorspellen op basis van grootte en locatie. We zouden kunnen beginnen met een eenvoudige lineaire functie, zoals we zagen in Hoofdstuk 2, om dit te modelleren:

In deze functie gelden de volgende definities:

- heten gewichten—ze bepalen hoeveel elk inputkenmerk bijdraagt. We zullen ze vaak tegenkomen.

- is de bias—het geeft een basisvoorspelling, zoals beseffen dat een huis nooit voor slechts €1 verkocht wordt.

- Het doel is de juiste waarden vinden voor en .

En weet je nog dat we zeiden dat de input van de functie is? Hier hebben we opgesplitst in twee: grootte () en locatie (), beide zijn inputkenmerken. Daarom kunnen we dit ook wiskundiger schrijven als:

Deze zogenaamde gewichten zijn cruciaal in machine learning—ze werken als volumeknoppen die bepalen hoeveel invloed elke input heeft op de uiteindelijke voorspelling:

- Als locatie belangrijker is dan grootte, zal groter zijn dan .

- Als grootte nauwelijks uitmaakt, zal dicht bij nul zijn.

- Negatieve gewichten betekenen dat een kenmerk de voorspelling juist naar de andere kant stuurt.

Hieronder zie je enkele variaties in gewichten en bias—kijk hoe verschillende perspectieven de prijsfunctie veranderen:

Lineaire functies zijn de eenvoudigste manier om data te modelleren. Maar zodra we verder gaan, wordt het snel complex—niet-lineaire functies zijn krachtiger, maar ook moeilijker te trainen en te begrijpen. In de toekomst zullen we ook andere functietypes tegenkomen:

- Beslisbomen: Gebruiken vertakkende ja/nee-vragen (zoals een stroomdiagram).

- Neurale Netwerken: Combineren veel eenvoudige functies om complexe patronen te leren.

De keuze hangt af van je data en de complexiteit van het probleem. Simpele problemen kunnen goed werken met lineaire functies, terwijl complexe problemen zoals beeldherkenning meer geavanceerde aanpakken nodig hebben.

Stap 3: De Functie Trainen Om Fouten Te Minimaliseren

Als we eenmaal ons functietype hebben gekozen, moeten we het model trainen, oftewel leren nauwkeurige voorspellingen maken door veel voorbeelden te laten zien. Begrippen als model, functie en systeem zijn hier uitwisselbaar—ze draaien om dezelfde kernideeën.

De Trainingslus:

- Start met willekeurige gewichten: De functie doet willekeurige voorspellingen.

- Maak voorspellingen: Voer trainingsdata door de huidige functie.

- Bereken fouten: Vergelijk voorspellingen met juiste antwoorden.

- Pas gewichten aan: Gebruik wiskundige technieken om fouten te verkleinen.

- Herhaal: Ga door totdat voorspellingen nauwkeurig genoeg zijn.

🐱 Voorbeeld Kattenherkenning: Stel dat we een model trainen om katten in foto’s te herkennen. In de eerste fase raden willekeurige gewichten willekeurig—misschien 50% nauwkeurigheid.

- Na 100 voorbeelden: Iets beter dan gokken—ongeveer 60% nauwkeurigheid.

- Na 1.000 voorbeelden: Begint basispatronen te herkennen—70% nauwkeurigheid.

- Na 10.000 voorbeelden: Herkent kattenkenmerken betrouwbaar—90% nauwkeurigheid.

Maar hoe weet een AI-systeem hoe het de gewichten moet aanpassen? Hier komen afgeleiden uit Hoofdstuk 2 in beeld! Het systeem berekent hoe het aanpassen van elk gewicht de fout beïnvloedt, en past ze vervolgens aan in de richting die fouten verkleint. Dit gradient descent-proces behandelen we uitgebreid in latere hoofdstukken.

Voor het huizenprijsvoorbeeld: als het model €300.000 voorspelt maar de echte prijs €250.000 is, bedraagt de fout €50.000. Het trainingsproces past de gewichten aan om toekomstige voorspellingen dichter bij de werkelijkheid te brengen.

Stap 4: Generalisatie Testen Op Nieuwe Data

De ultieme test van machine learning is niet hoe goed het presteert op trainingsdata, maar hoe goed het werkt op volledig nieuwe voorbeelden die het nog nooit heeft gezien.

Goede machine learning-praktijk splitst data op:

- Trainingsdata (70–80%): Gebruikt om gewichten aan te passen en patronen te leren.

- Testdata (20–30%): Verborgen tijdens training, alleen gebruikt voor eindbeoordeling. Het model heeft deze data nooit gezien en we gebruiken het om zijn capaciteiten te testen.

Succesvolle Generalisatie: Een goed getraind model herkent handgeschreven cijfers van verschillende handschriften, detecteert spam ook als spammers hun tactieken aanpassen, voorspelt huizenprijzen in buurten die niet in de training zaten en herkent katten in foto’s met verschillende camera’s, belichting en hoeken.

Soms valsspelen modellen door trainingsvoorbeelden te onthouden in plaats van echte patronen te leren:

- Goed Leren: "Kattenfoto’s hebben meestal driehoekige oren, snorharen en vachtexturen".

- Slecht Memoreren: "Afbeelding #1247 in mijn trainingsset is een kat".

Het memoriserende model faalt op nieuwe kattenfoto’s omdat het nooit geleerd heeft wat een kat maakt—het onthield alleen specifieke trainingsbeelden.

Daarom is testdata zo belangrijk: het helpt ons het model te beoordelen. Wanneer een model 99% nauwkeurigheid behaalt op trainingsdata maar slechts 60% op testdata, heeft het gememoriseerd in plaats van geleerd. Goede generalisatie laat vergelijkbare prestaties zien op beide (bijvoorbeeld 85% vs. 83%), wat aangeeft dat het overdraagbare patronen heeft geleerd.

Belangrijkste Inzichten

Machine learning verandert de uitdaging van het programmeren van intelligent gedrag in een systematisch optimalisatieproces. Door echte data om te zetten in getallen, geschikte wiskundige functies te kiezen, te trainen via iteratieve gewichtsaanpassing en te valideren met generalisatietests, leren machine learning-systemen patronen te herkennen en nauwkeurige voorspellingen te maken.

Het kerninzicht is dat leren plaatsvindt via wiskundige optimalisatie—het geleidelijk aanpassen van functieparameters om voorspellingsfouten te minimaliseren—en niet via begrip of redeneren zoals mensen dat doen.