Elke reinforcement learning-agent staat voor hetzelfde klassieke dilemma: gebruik maken van wat werkt (exploitatie) of iets nieuws proberen dat misschien beter is (exploratie)? Dit evenwicht bepaalt hoe agents leren en zich aanpassen.

Het dilemma is universeel—restaurants die populaire gerechten balanceren met nieuwe recepten, studenten die kiezen tussen bekende en nieuwe vakken, of streamingdiensten die veilige aanbevelingen mengen met frisse suggesties.

In reinforcement learning leidt te veel exploitatie tot gemiste kansen, terwijl te veel exploratie tijd verspilt aan onzekere acties. De juiste balans vinden is de sleutel tot intelligente besluitvorming.

Het Kernprobleem

De exploration-exploitation trade-off ontstaat omdat agents beperkte tijd en kansen hebben om te leren. Elke action dient één van twee doelen:

- Exploitation: Het benutten van huidige kennis door actions te kiezen die op basis van ervaring waarschijnlijk goed presteren.

- Exploration: Het proberen van nieuwe actions die mogelijk betere strategieën onthullen, ook al leveren ze op korte termijn misschien slechtere prestaties op.

De wiskundige spanning kan eenvoudig worden weergegeven:

Pure exploitation maximaliseert onmiddellijke prestaties maar kan kansen voor langetermijnverbetering missen. Pure exploration levert maximale nieuwe informatie op maar gaat ten koste van prestaties tijdens het leerproces. De optimale strategie vindt een balans tussen beide.

De uitdaging is dat deze balans afhangt van de situatie—hoeveel al bekend is, hoeveel tijd er nog resteert om te leren, en hoe kostbaar fouten zijn tijdens het leerproces.

Het Multi-Armed Bandit Probleem

Het klassieke voorbeeld is het multi-armed bandit probleem, genoemd naar gokautomaten. Stel: je hebt meerdere machines, elk met onbekende kans op uitbetaling. Met beperkt aantal trekkingen moet je beslissen of je blijft bij de beste bekende machine of andere test.

De situatie:

- Elke machine heeft een vaste maar onbekende kans om uit te betalen.

- Je ontdekt de uitbetalingskansen alleen door de machines te proberen.

- Elke poging die je besteedt aan leren, gaat ten koste van pogingen bij de beste machine.

- Je moet dus balanceren tussen ontdekken welke machines goed zijn en het benutten van die kennis.

Waarom pure strategieën falen:

- Pure exploration: Je probeert elke machine even vaak en leert hun kansen kennen, maar benut de beste nooit optimaal.

- Pure exploitation: Na enkele pogingen kies je altijd de machine die voorlopig het beste lijkt, maar loopt zo het risico betere alternatieven te missen.

Het multi-armed bandit-probleem laat zien waarom naïeve strategieën tekortschieten en waarom geavanceerde exploratiestrategieën noodzakelijk zijn.

Epsilon-Greedy Strategie

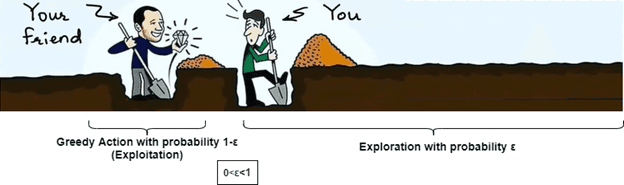

Een van de eenvoudigste exploratiestrategieën is epsilon-greedy, die de trade-off expliciet maakt met één parameter.

Het algoritme:

- Met kans ε (epsilon) kies je een willekeurige action (exploration)

- Met kans 1-ε kies je de best bekende action (exploitation)

Deze vergelijking laat zien hoe één parameter ε direct de balans tussen exploration en exploitation bepaalt.

De methode is eenvoudig te implementeren en te begrijpen, garandeert altijd enige exploratie en werkt goed in veel situaties. Toch is willekeurige exploratie inefficiënt: de agent kan herhaaldelijk actions proberen waarvan al bekend is dat ze slecht presteren, in plaats van zich te richten op veelbelovende maar onbekende opties.

Thompson Sampling

Thompson sampling hanteert een probabilistische benadering van exploratie door overtuigingen (beliefs) over action values bij te houden en actions te kiezen volgens de kans dat ze optimaal zijn.

De aanpak:

- Houd kansverdelingen bij over de waarde van elke action.

- Sample een waarde voor elke action uit zijn verdeling.

- Kies de action met de hoogste gesamplede waarde.

- Update de verdeling van de gekozen action op basis van de waargenomen reward.

Intuïtie: Actions die waarschijnlijk optimaal zijn, worden vaker gekozen, maar er blijft altijd een kans om andere actions te proberen als die beter zouden kunnen zijn. Naarmate bewijs zich opstapelt, worden de kansverdelingen scherper rond de werkelijke waarden.

Voordelen:

- Biedt een natuurlijke balans tussen exploration en exploitation

- Gaat principieel om met onzekerheid

- Presteert vaak zeer goed in de praktijk

- Past zich flexibel aan de structuur van het probleem aan

Thompson sampling geldt momenteel als beste manier voor veel problemen en laat zich goed uitbreiden naar complexere scenario’s.

Exploratie in Deep Reinforcement Learning

Wanneer agents opereren in complexe omgevingen met neurale netwerken als functiebenadering, wordt exploratie geavanceerder maar ook uitdagender.

Uitdagingen in deep RL:

- Hoog-dimensionale state spaces maken willekeurige exploratie inefficiënt.

- Neurale netwerken kunnen overmoedig zijn in slecht verkende gebieden.

- Credit assignment over lange reeksen actions bemoeilijkt het leren.

Geavanceerde exploratiestrategieën:

Curiosity-driven exploration: Agents krijgen intrinsieke rewards voor het bezoeken van states die verrassend of moeilijk te voorspellen zijn:

Count-based exploration: Houd bij hoe vaak verschillende states bezocht zijn en verken minder bezochte gebieden vaker:

Information-theoretic exploration: Zoek naar actions die de informatie over de omgeving maximaliseren of de onzekerheid over optimale policies verkleinen.

Deze benaderingen helpen agents systematisch te exploreren in complexe omgevingen, in plaats van willekeurig rond te dwalen.

De Explore-Exploit Levenscyclus

De balans tussen exploration en exploitation verschuift meestal in de tijd naarmate agents meer kennis en ervaring opdoen.

Vroege leerfase:

- Hoge exploratie: Veel verschillende actions uitproberen om de omgeving te begrijpen.

- Slechte prestaties accepteren terwijl informatie wordt verzameld.

- Focus op breedte van ervaring in plaats van optimalisatie.

Kennisopbouwfase:

- Gebalanceerde exploration-exploitation: Verder leren terwijl prestaties verbeteren.

- Exploratie richten op veelbelovende maar nog onzekere gebieden.

- Beginnen met specialiseren op basis van ontdekte patronen.

Volwassen prestatiefase:

- Lage exploratie: Focus op het benutten van goed begrepen strategieën.

- Af en toe exploratie om veranderingen in de omgeving te detecteren.

- Consistente hoge prestaties prioriteren.

Aanpassingsfase:

- Verhoogde exploratie wanneer prestaties verslechteren of de omgeving verandert.

- Snelle herbalancering op basis van nieuwe omstandigheden.

- Terug naar leerstand zodra bestaande kennis verouderd blijkt.

Deze levenscyclus weerspiegelt hoe expertise zich in veel domeinen ontwikkelt—brede initiële verkenning gevolgd door specialisatie en voortdurende aanpassing.

Toepassingen en Overwegingen in de Praktijk

De exploration-exploitation trade-off komt terug in tal van praktische AI-toepassingen:

🗣️ Aanbevelingssystemen: Balans tussen gebruikers bekende content tonen die ze waarschijnlijk waarderen en nieuwe mogelijkheden aanbieden die de betrokkenheid op lange termijn vergroten.

🚗 Autonome voertuigen: Balans tussen het volgen van bewezen veilige routes en het verkennen van mogelijk betere trajecten, met behoud van veiligheid.

💊 Geneesmiddelenontwikkeling: Balans tussen het testen van varianten van bekende effectieve verbindingen en het verkennen van volledig nieuwe chemische structuren.

📈 Online marketing: Balans tussen het inzetten van bewezen campagnes en het testen van nieuwe creatieve benaderingen of targetingstrategieën.

Belangrijkste Inzichten

Het dilemma tussen exploration en exploitation vormt een van de meest fundamentele uitdagingen in reinforcement learning en intelligente besluitvorming in het algemeen. Effectieve agents moeten de tegenstrijdige eisen balanceren: goed presteren met bestaande kennis én blijven leren en zich aanpassen.

Inzicht in deze trade-off verklaart veel gedrag dat we zowel in AI-systemen als bij menselijke besluitvorming zien. De meest succesvolle benaderingen lossen de spanning niet op, maar beheren deze op een intelligente manier—exploreren wanneer onzekerheid groot is en informatie waardevol, exploiteren wanneer vertrouwen hoog is en prestaties het belangrijkst zijn.

Naarmate AI-systemen geavanceerder worden en worden ingezet in steeds complexere omgevingen, wordt het beheersen van exploration en exploitation nog crucialer om zowel leerprogressie als betrouwbare prestaties in de praktijk te waarborgen.